Per molti responsabili della sicurezza, l'aggressore più pericoloso non è all'esterno, ma è già all'interno. Le minacce interne, provenienti da dipendenti malintenzionati o amministratori disonesti, hanno già superato l'ostacolo più difficile in un attacco: ottenere l'accesso, spesso privilegiato. Ciò significa che possono operare con credenziali affidabili, autorizzazioni esistenti e una conoscenza approfondita dei vostri sistemi e dati.

Questo è il motivo per cui le minacce interne sono spesso più difficili da individuare e contenere. Secondo il rapporto IBM "Cost of a Data Breach 2025", gli attacchi interni dolosi costano in media 4,92 milioni di dollari e richiedono 260 giorni per essere risolti, rendendoli tra gli incidenti più costosi e di più lunga durata che i responsabili della sicurezza devono affrontare.

Tra le implementazioni attive Vectra AI , quasi 4 minacce su 10 classificate come prioritarie erano minacce interne nell'arco di un mese. Non si tratta di un caso raro. È ciò che sta accadendo ora negli ambienti aziendali reali, e accade spesso.

Quali sono le lacune nei programmi di gestione delle minacce interne?

Anche i programmi di sicurezza più maturi spesso si affidano a un trio di strumenti ben noti per gestire i rischi legati alle minacce interne, ma ciascuno di essi presenta un punto debole che gli aggressori sfruttano:

- DLP - Segnala o blocca determinati trasferimenti di dati, ma non è in grado di individuarne l'intento. Se un dipendente scarica file sensibili a cui è autorizzato ad accedere, il DLP lo considera una normale attività aziendale.

- EDR - Eccellente nell'individuare malware endpoint , ma incapace di rilevare gli abusi degli account nei livelli SaaS, cloud e identità, dove si verificano molti incidenti interni.

- SIEM - Aggrega i log per l'analisi, ma non collega i punti tra azioni sottili e separate su sistemi diversi senza una complessa correlazione manuale.

Queste lacune esistono perché gli addetti ai lavori operano con autorizzazioni legittime. Le loro azioni si confondono con i flussi di lavoro di routine, aggirando i controlli incentrati sulla prevenzione. Senza correlare i comportamenti tra identità, cloud e rete locale, i segnali rimangono sparsi e non riconosciuti.

Il risultato? Quando una minaccia interna diventa evidente a questi strumenti, i dati sensibili sono già stati sottratti o il danno è già stato fatto.

In che modo l'IA generativa aumenta i rischi di minacce interne?

L'ascesa dell'IA generativa sul posto di lavoro, in particolare di strumenti come Copilot per Microsoft 365, aggiunge una nuova dimensione alle minacce interne.

Se un malintenzionato interno o un account compromesso dispone dell'accesso a Copilot, può utilizzare la sua ricerca AI unificata per eseguire query su Word, SharePoint, Teams, Exchange e altre superfici Microsoft in pochi secondi. I dati sensibili che potrebbero richiedere ore o giorni per essere individuati manualmente possono essere scoperti e preparati per l'esfiltrazione quasi istantaneamente.

Perché questo è importante per le minacce interne:

- Ricognizione accelerata. Copilot elimina la latenza dalla fase di scoperta. Un insider può far emergere credenziali, dati finanziari o proprietà intellettuale alla velocità dell'IA.

- Vantaggio derivante dal vivere della terra. Gli aggressori utilizzano autorizzazioni esistenti e strumenti di intelligenza artificiale aziendali affidabili, integrandosi perfettamente con le attività legittime degli utenti.

- Visibilità nativa limitata. I team di sicurezza vedono dettagli minimi dai registri di audit di Copilot, rendendo difficile sapere cosa è stato cercato o restituito.

- Controlli nativi insufficienti. Le restrizioni integrate in Copilot non sono sufficienti a impedire a persone interne determinate di sondare l'ambiente alla ricerca di informazioni sensibili, e gli strumenti nativi non rilevano quando gli aggressori compromettono un'identità per abusare dell'uso legittimo di Copilot per M365.

Perché le minacce interne sono così difficili da individuare?

I comportamenti normali e quelli dannosi sono quasi indistinguibili senza un contesto:

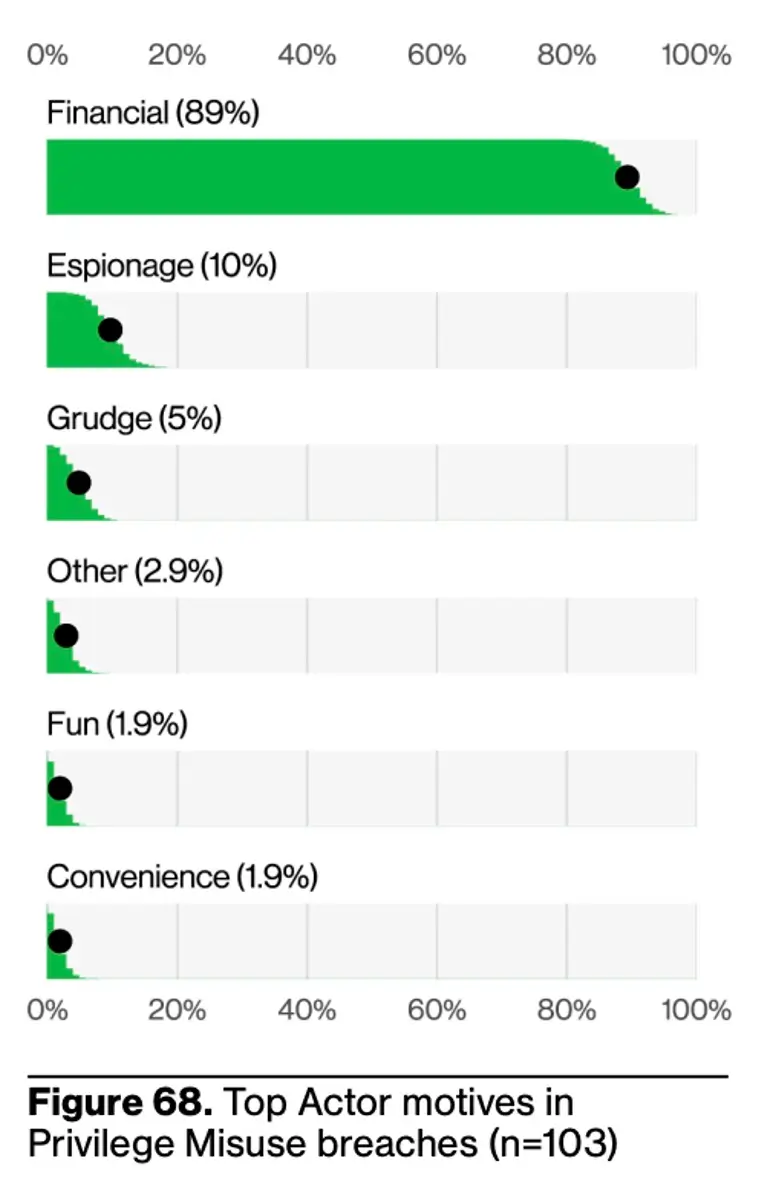

La sfida è aggravata dalla motivazione e dall'opportunità. Secondo il rapporto Verizon 2025 Data Breach Investigation Report, la stragrande maggioranza degli incidenti interni è motivata da ragioni finanziarie, con gli amministratori disonesti che rappresentano il rischio di maggiore impatto. Negli ambienti cloud, i dati sensibili possono essere identificati e rubati in pochi secondi, ben prima che la maggior parte dei team di sicurezza abbia il tempo di reagire.

Secondo Verizon, il 90% dei principali responsabili delle violazioni legate all'uso improprio dei privilegi è interno all'azienda, mentre il 10% è costituito da partner. Il motivo principale rimane l'incentivo finanziario.

La chiave è capire come viene utilizzato l'accesso (la sequenza, il contesto e l'intento dietro ogni azione) e non solo che l'accesso è avvenuto. Per individuare le vere minacce interne è necessaria un'intelligenza artificiale basata sul comportamento, in grado di distinguere le intenzioni malevole dalle anomalie quotidiane.

Tre priorità strategiche per rafforzare i programmi contro le minacce interne

1. Estendere la visibilità ai comportamenti relativi all'identità in tutti gli ambienti

Gli insider operano su Active Directory, M365, SharePoint, Teams, Exchange, Entra ID, Copilot per M365, Cloud risorse di rete. Senza correlazione, ogni azione appare innocua se considerata isolatamente. È essenziale avere una visibilità completa dell'identità.

2. Rilevare le intenzioni malevole in una fase più precoce della catena di attacco

L'escalation dei privilegi, lo staging insolito dei dati e i meccanismi di persistenza spesso si verificano giorni o settimane prima dell'esfiltrazione. Il rilevamento tempestivo in questa fase riduce drasticamente l'impatto e i costi di risposta.

3. Correlare e consolidare i rilevamenti per una risposta decisiva

I team di sicurezza non possono indagare su ogni anomalia. Il monitoraggio comportamentale sintetizza migliaia di eventi di basso livello in una manciata di casi altamente affidabili con contesto completo, consentendo un'azione rapida e sicura.

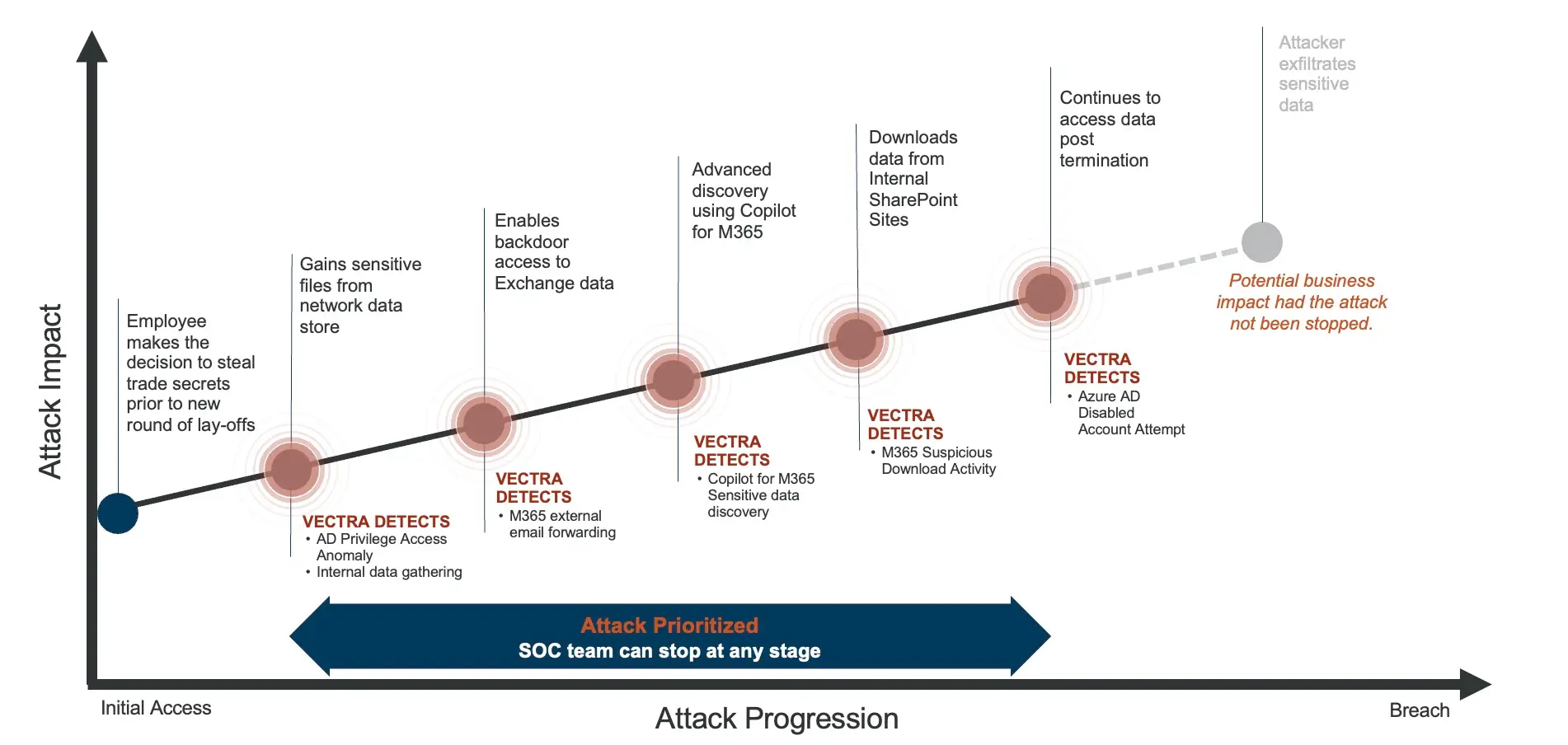

Un caso reale: come Vectra AI una minaccia interna

In un'azienda manifatturiera industriale, un amministratore IT che è a conoscenza dei prossimi licenziamenti:

- Raccolti file sensibili dagli archivi dati di rete.

- Inoltrato l'e-mail di Exchange a un account esterno.

- Utilizzo di Copilot per M365 per individuare dati sensibili

- Dati SharePoint scaricati al di fuori dei normali schemi.

- Tentativi di accesso post-cessazione a account disabilitati.

I controlli tradizionali non riuscivano a collegare queste azioni in tempo. Vectra AI è riuscita a farlo, correlando ogni fase in un unico caso altamente attendibile, consentendo un rapido contenimento e supportando l'azione legale.

Vectra AI di Vectra AI per le minacce interne

- Riduzione comprovata dei rischi. Rileva e blocca tempestivamente le minacce interne, riducendo al minimo l'impatto finanziario e operativo.

- Rilevamento AI basato sul comportamento. Aggiunge il livello comportamentale mancante nei programmi fortemente orientati alla prevenzione.

- Visibilità su più superfici. Identità, cloud, Gen AI e rete, in un'unica vista correlata.

- Riduzione del rumore su larga scala. Secondo Vectra AI , il 99,98% dei rilevamenti viene filtrato prima di raggiungere gli analisti .

- Consente un rapido contenimento delle indagini. Dal blocco automatico degli account al contesto completo dei metadati, per fermare gli abusi prima che i dati vengano divulgati e per capire a quali file è stato effettuato l'accesso e la portata completa dell'attacco.

- Si integra con gli strumenti esistenti. Completa e rafforza DLP, EDR e SIEM per ridurre il rischio di minacce interne senza modificare il flusso di lavoro esistente.

Le minacce interne non sono solo una questione di conformità, ma rappresentano un rischio concreto per l'azienda. Per affrontarle è necessario andare oltre l'ispezione dei contenuti e passare al rilevamento comportamentale basato sull'identità.

L'insider è già dentro. La domanda è: riuscirete a vedere cosa sta facendo in tempo per fermarlo?

Fai il passo successivo nella protezione dalle minacce interne

Le minacce interne richiedono più che semplici controlli preventivi: necessitano di un sistema di rilevamento basato sull'intelligenza artificiale che sia in grado di individuare le intenzioni malevole in tempo reale, su ogni identità e in ogni ambiente. Sei pronto a rafforzare il tuo programma di rilevamento delle minacce interne? Guarda Vectra AI in azione: